Aya Vision – Cohere 推出多模态、多语言的视觉模型

2025-04-16 12:41:06 小编:六六导航站

Aya Vision是什么

Aya Vision 是 Cohere 推出的多模态、多语言的视觉模型,提升全球范围内的多语言和多模态通信能力。支持 23 种语言,能执行图像描述生成、视觉问答、文本翻译和多语言摘要生成等任务。Aya Vision 有两个版本:Aya Vision 32B 和 Aya Vision 8B,分别在性能和计算效率上各有优势。模型通过合成标注和多语言数据增强技术进行训练,能在资源有限的情况下实现高效表现。

Aya Vision的主要功能

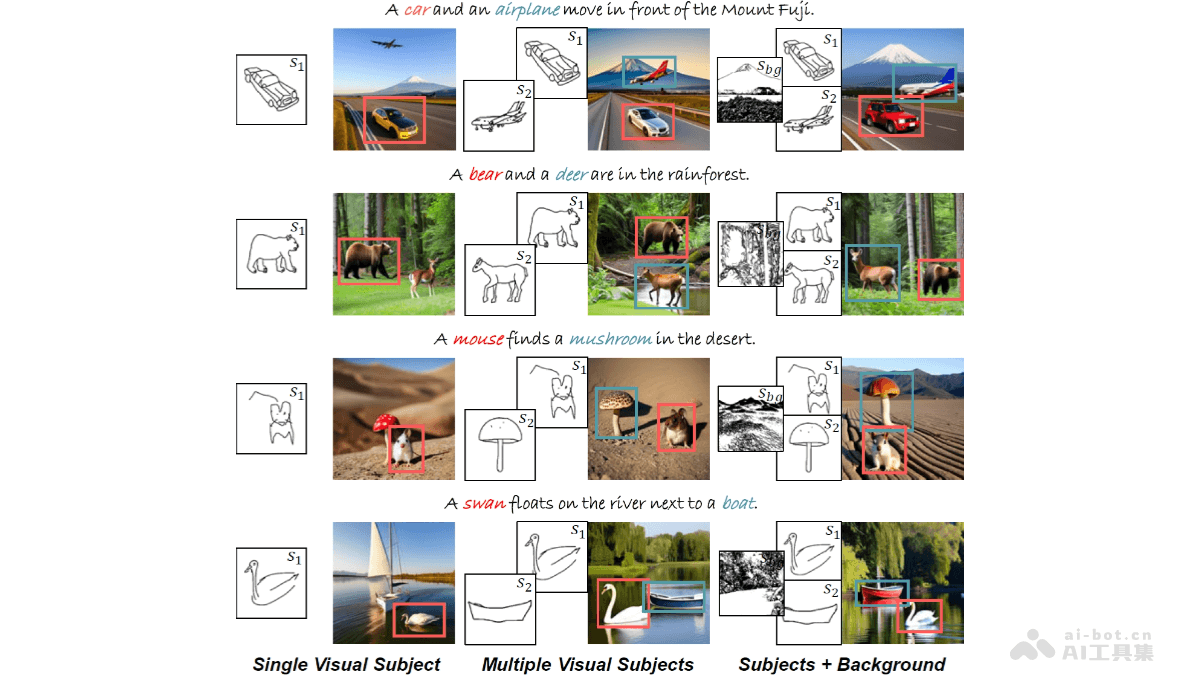

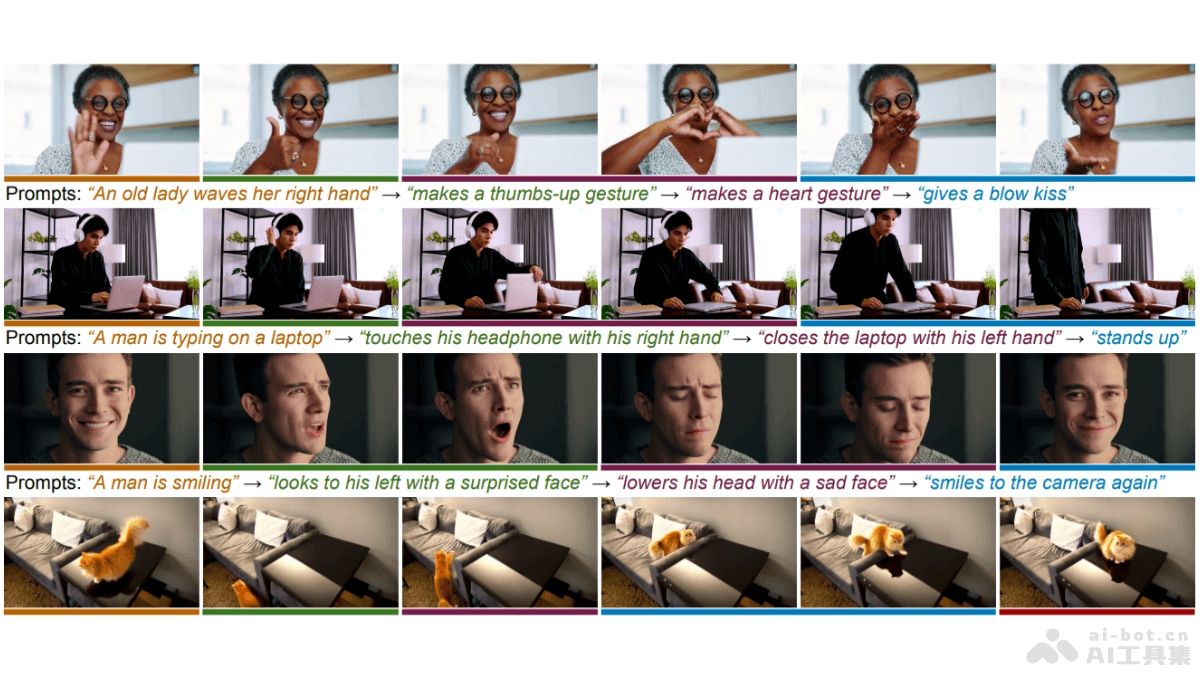

图像描述生成:Aya Vision 能根据输入的图像生成准确且详细的描述文本,帮助用户快速理解图像内容,适用于视觉障碍人士或需要快速提取图像信息的场景。视觉问答(VQA):用户可以上传图片并提出与图片相关的问题,Aya Vision 能结合视觉信息和语言理解能力,提供准确的答案。多语言支持:Aya Vision 支持 23 种主要语言,能处理多语言的文本输入和输出。可以在不同语言环境中生成图像描述、回答问题或翻译文本,打破语言壁垒。文本翻译与摘要生成:Aya Vision 能翻译文本内容,生成简洁的摘要,帮助用户快速获取关键信息。跨模态理解与生成:Aya Vision 能将视觉信息与语言信息相结合,实现跨模态的交互。例如,可以将图像内容转化为文本描述,或将文本指令转化为视觉搜索结果。Aya Vision的技术原理

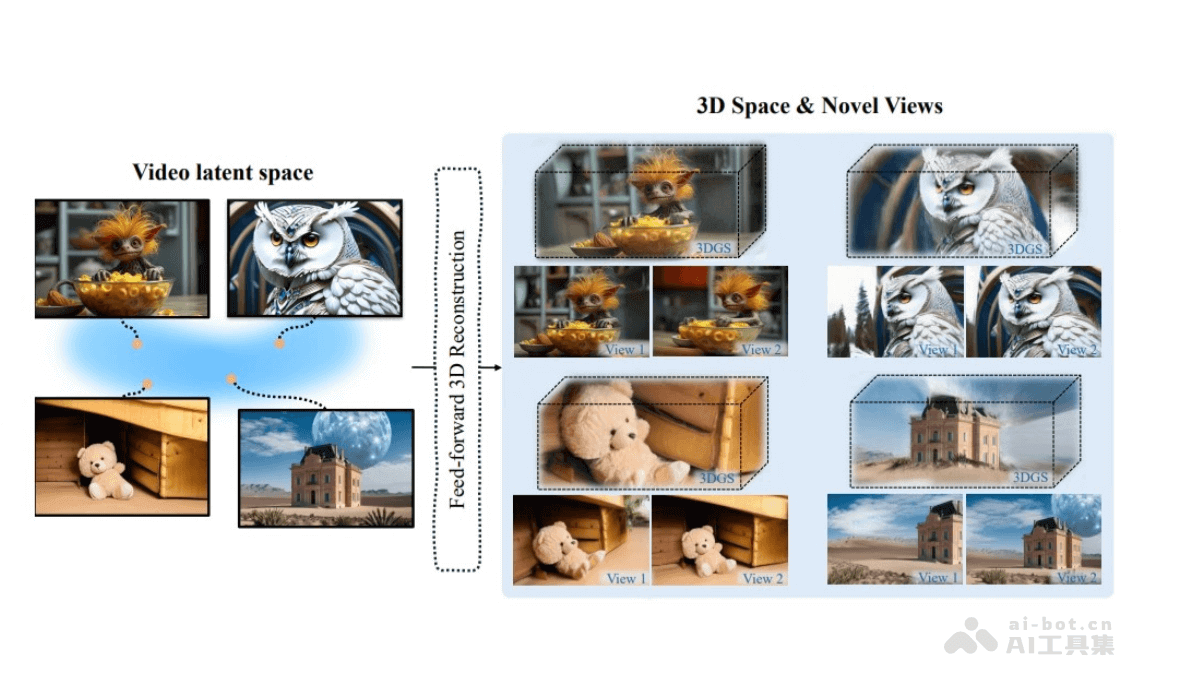

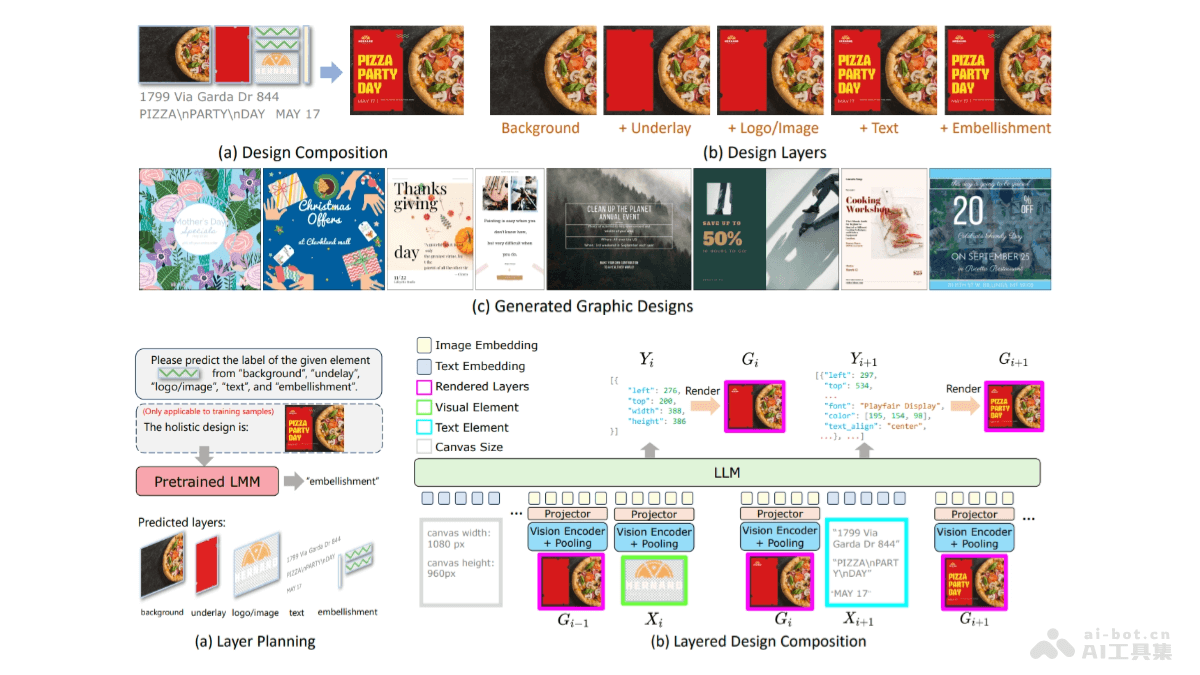

多模态架构:Aya Vision 采用模块化架构,包含视觉编码器、视觉语言连接器和语言模型解码器。视觉编码器基于 SigLIP2-patch14-384,负责提取图像特征;视觉语言连接器将图像特征映射到语言模型的嵌入空间,解码器用于生成文本输出。合成标注与数据增强:为了提升多语言性能,Aya Vision 使用合成标注(由 AI 生成的标注)进行训练。这些标注通过翻译和重述处理,增强了多语言数据的质量。模型采用了动态图像分辨率处理和像素混洗下采样技术,提高计算效率。两阶段训练过程:Aya Vision 的训练分为两个阶段:视觉语言对齐和监督微调。第一阶段对齐视觉和语言表示,第二阶段则在多模态任务上联合训练连接器和语言模型。高效计算性能: Aya Vision 的参数规模较小(8B 和 32B),但性能在多个基准测试中超越了更大规模的模型,如 Llama-3.2 90B Vision。在于高效的训练策略和对计算资源的优化。Aya Vision的项目地址

项目官网:CohereHuggingFace模型库:https://huggingface.co/collections/CohereForAI/c4ai-aya-visionAya Vision的应用场景

教育领域:Aya Vision 可以帮助学生和教师更好地理解视觉内容。例如,通过图像描述功能,学生可以快速了解艺术品的风格和起源。内容创作:Aya Vision 能为多语言网站生成图像描述,提升用户体验。可以用于生成创意内容,如新闻报道、故事或诗歌等。辅助工具:Aya Vision 可以作为辅助工具,帮助视觉障碍人士通过图像描述理解周围环境。多语言翻译与交流:Aya Vision 支持 23 种语言的文本翻译和摘要生成,能帮助用户跨越语言障碍进行交流。研究与开发:研究人员可以基于高效性和多语言支持能力,探索新的应用场景。- 猜你喜欢

-

MusicTGA-HR提示指令

MusicTGA-HR提示指令 -

RappingAI提示指令

RappingAI提示指令 -

Boomy提示指令

Boomy提示指令 -

TwoShot提示指令

TwoShot提示指令 -

Weet提示指令

Weet提示指令 -

Muzaic Studio提示指令

Muzaic Studio提示指令 -

-

HookGen提示指令

HookGen提示指令 -

DadaBots提示指令

DadaBots提示指令

- 相关AI应用

-

Playlistable提示指令

Playlistable提示指令 -

Riffusion提示指令

Riffusion提示指令 -

WZRD提示指令

WZRD提示指令 -

-

Cyanite.ai提示指令

Cyanite.ai提示指令 -

Piano Genie提示指令

Piano Genie提示指令 -

Synthesizer V提示指令

Synthesizer V提示指令 -

Cosonify提示指令

Cosonify提示指令 -

Musico提示指令

Musico提示指令

- 推荐AI教程资讯

- Aya Vision – Cohere 推出多模态、多语言的视觉模型

- BGE-VL – 智源研究院联合多所高校开源的多模态向量模型

- 混元图生视频 – 腾讯混元开源的图生视频模型

- Granite 3.2 – IBM 开源的多模态系列 AI 模型

- Resume Matcher – 开源AI简历优化工具,解析简历和职位描述提供改进建议

- 留学生第一篇essay怎么写

- 非程序员也能搭建个人网页

- 史上最贵 API!比 DeepSeek-R1 贵千倍,OpenAI 高价劝退一批用户!

- 一分钟免费生成PPT

- 凌晨“激战”!谷歌亮相新模型,OpenAI 紧急甩出 GPT-4o 动动嘴就能 P 图,网友:又要感谢 DeepSeek 了