QA-MDT – 中科大联合科大讯飞推出开源音乐生成模型

2025-02-13 13:30:01 小编:六六导航站

QA-MDT是什么

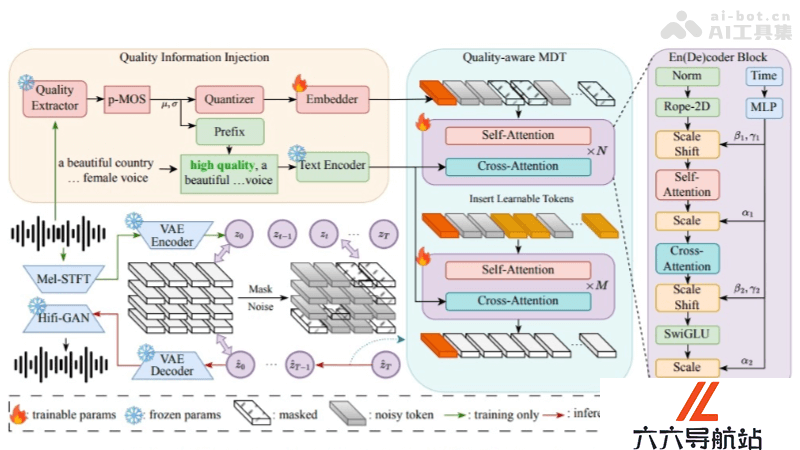

QA-MDT(Quality-aware Masked Diffusion Transformer)是由中国科学技术大学和科大讯飞联合推出的开源音乐生成模型。模型基于文本描述生成高质量且音乐性强的音乐,创新的质量感知训练策略,在训练过程中识别并提升音乐波形的质量。QA-MDT结合掩蔽扩散变换器(MDT)和质量控制技术,实现在大规模数据集上的卓越性能,为音乐制作和多媒体创作提供强大的工具。

QA-MDT的主要功能

文本到音乐的生成:用户提供文本描述,QA-MDT生成与之相匹配的音乐。质量控制:模型识别和提升生成音乐的质量,确保输出的音乐具有高保真度。数据集优化:通过预处理和优化数据集,提高音乐和文本的对齐度。多样性生成:模型能生成风格多样的音乐,满足不同用户的需求。QA-MDT的技术原理

文本到音乐的生成:基于自然语言处理(NLP)技术解析文本,转换为音乐特征,然后生成音乐。质量感知训练:在训练过程中,使用质量评分模型(如伪MOS分数)评估音乐样本的质量,模型生成高质量音乐。掩蔽扩散变换器(MDT):基于Transformer的架构,掩蔽和预测音乐信号的部分内容来学习音乐的潜在表示,提高音乐生成的准确性。质量控制:在生成阶段,基于训练阶段学到的质量信息引导模型生成高质量音乐。音乐和文本同步:用大型语言模型(LLMs)和CLAP模型同步音乐信号与文本描述,增强文本与音频之间的一致性。QA-MDT的项目地址

GitHub仓库:https://github.com/QA-MDTarXiv技术论文:https://arxiv.org/pdf/2405.15863v2QA-MDT的应用场景

广告和多媒体制作:为广告、电影、电视、视频游戏和在线视频生成定制的背景音乐和音效。音乐产业:辅助音乐制作人和作曲家创作新的音乐作品,提供创意灵感或作为创作过程中的工具。音乐教育:作为教学工具,帮助学生理解音乐理论和作曲技巧,或用于音乐练习和即兴演奏。音频内容创作:为播客、有声书和其他音频内容创作提供原创音乐,增强听众的听觉体验。虚拟助手和智能设备:在智能家居设备、虚拟助手或其他智能系统中生成个性化的音乐和声音,提升用户体验。- 猜你喜欢

-

chatnio提示指令

chatnio提示指令 -

NineF AI提示指令

NineF AI提示指令 -

ChatGPT Gratis提示指令

ChatGPT Gratis提示指令 -

-

Entar.io提示指令

Entar.io提示指令 -

Browse GPT提示指令

Browse GPT提示指令 -

HealthGPT提示指令

HealthGPT提示指令 -

ChatGPT Writer提示指令

ChatGPT Writer提示指令 -

Water提示指令

Water提示指令

- 相关AI应用

- 推荐AI教程资讯

- QA-MDT – 中科大联合科大讯飞推出开源音乐生成模型

- 书生·筑梦2.0(Vchitect 2.0) – 上海人工智能实验室推出的AI视频生成模型

- AI Youtube Shorts Generator – 开源的AI视频编辑工具,自动分析视频提取精彩片段

- PhotoPrism – 开源的AI照片管理工具,AI驱动的照片分类和搜索功能

- Claude Dev – AI编程助手,基于Claude 3.5 Sonnet模型

- FaceSwap – 开源的在线AI换脸工具,深度伪造视频和图像

- Seed-Music – 字节跳动推出的AI音乐生成大模型

- ConFiner – 高质量长视频生成框架,可制作长达600帧的连贯视频

- M2UGen – 腾讯联合国立大学推出多模态音乐理解和生成框架

- Nemotron-Mini-4B-Instruct – 英伟达推出的开源小型语言模型