AI教程资讯

-

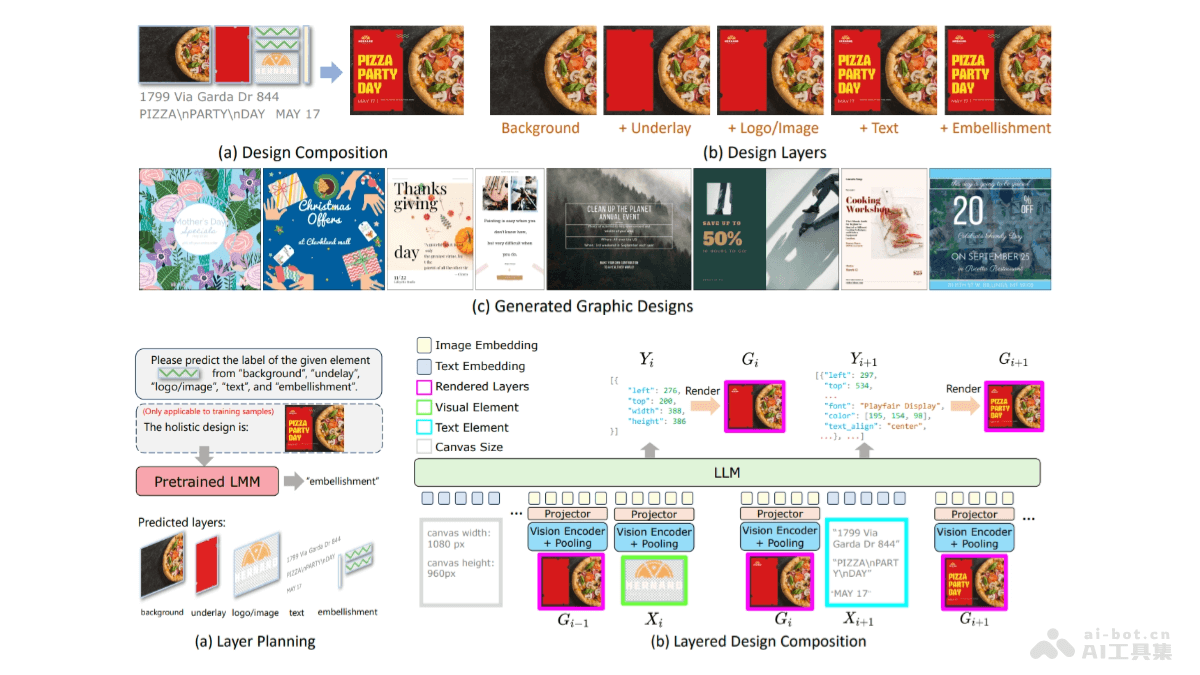

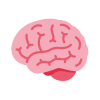

LaDeCo – 西安交大联合微软推出的自动图形设计构图方法

发表时间:2025-01-02

LaDeCo是西安交通大学和微软研究院联合推出的自动图形设计构图方法,基于将设计任务分解为层次化的步骤来实现。LaDeCo对输入的设计元素进行层规划,将它们分配到不同的语义层,比如背景、底层、图像 标志、文本和装饰。

【全文阅读】

-

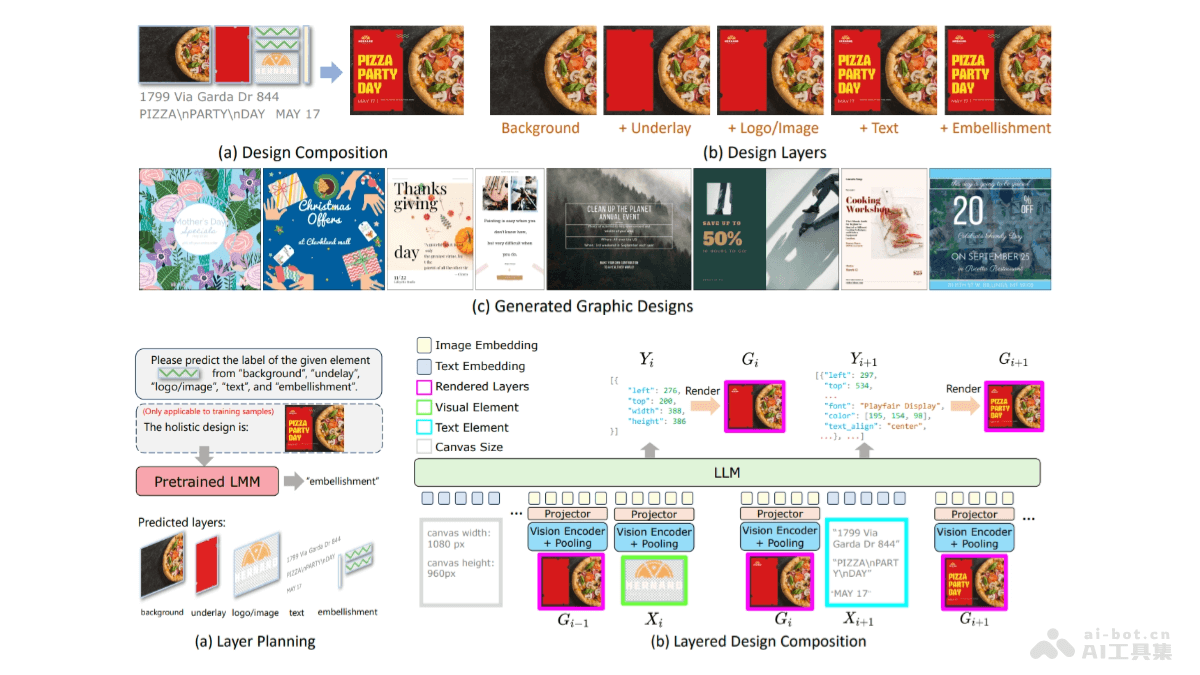

SEMIKONG – 专为半导体领域设计的大型语言模型

发表时间:2025-01-02

SEMIKONG是专门为半导体行业定制的大型语言模型(LLM),是Aitomatic、FPT Software和东京电子有限公司联合推出的。基于深入的领域知识,解决半导体制造和设计中的独特挑战,如复杂的物理和化学问题。

【全文阅读】

-

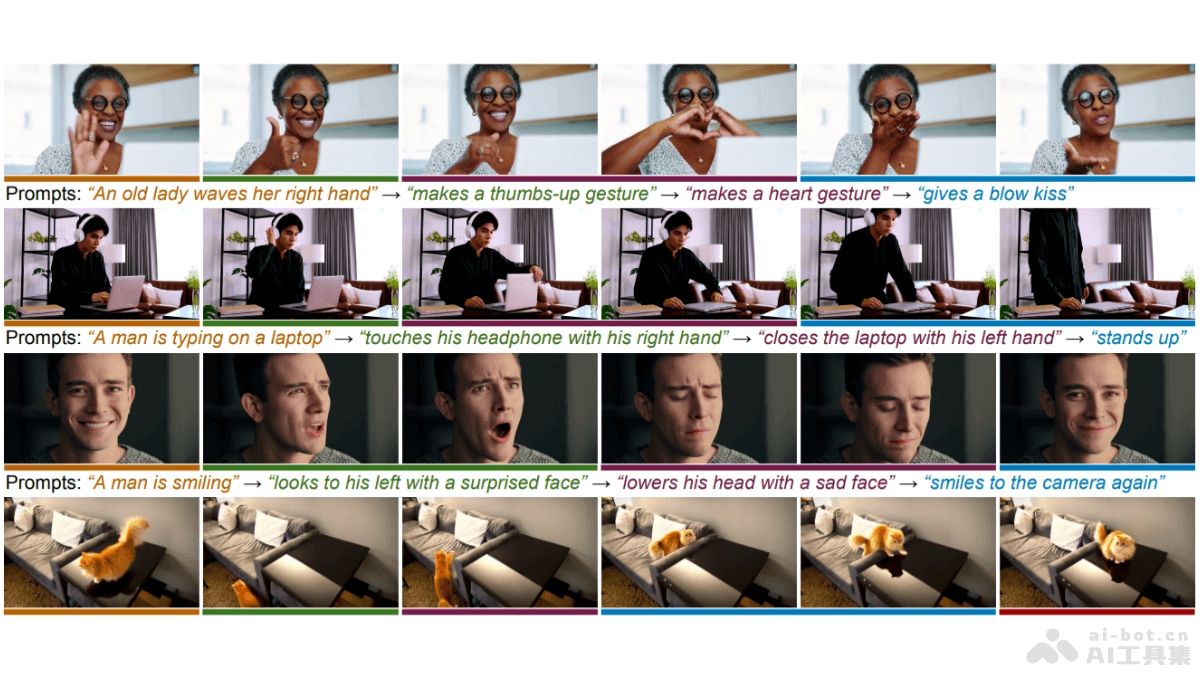

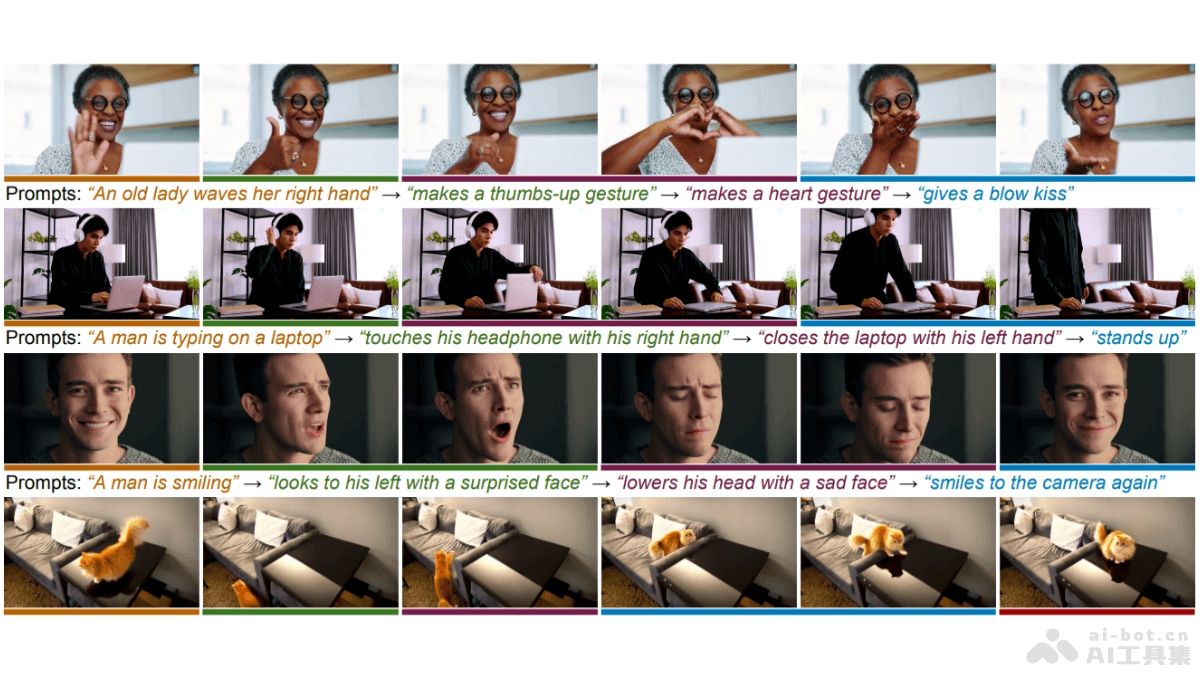

MinT – 生成顺序事件的文本转视频模型,灵活控制时间戳

发表时间:2025-01-02

MinT(Mind the Time)是Snap Research、多伦多大学和向量研究所联合推出的多事件视频生成框架,基于精确的时间控制,根据文本提示生成包含多个事件的视频序列。MinT的核心技术是时间基位置编码(ReRoPE),让模型能将特定的文本提示与视频中的相应时间段关联起来,确保事件按顺序发生,控制每个事件的持续时间。

【全文阅读】

-

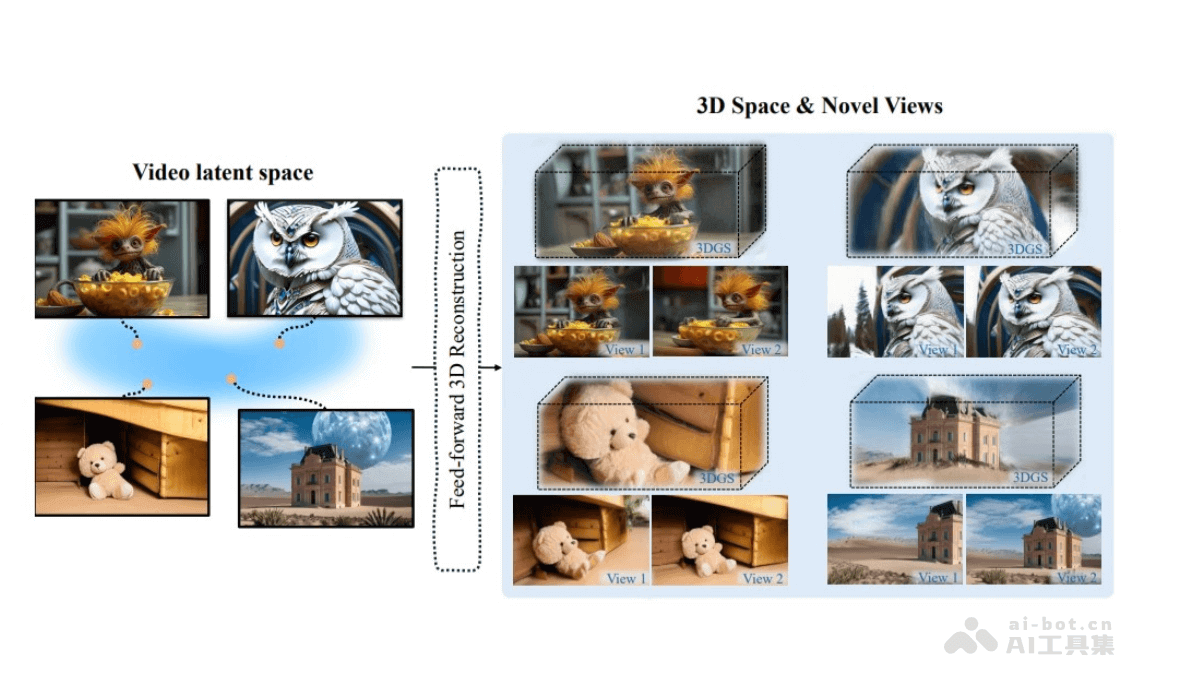

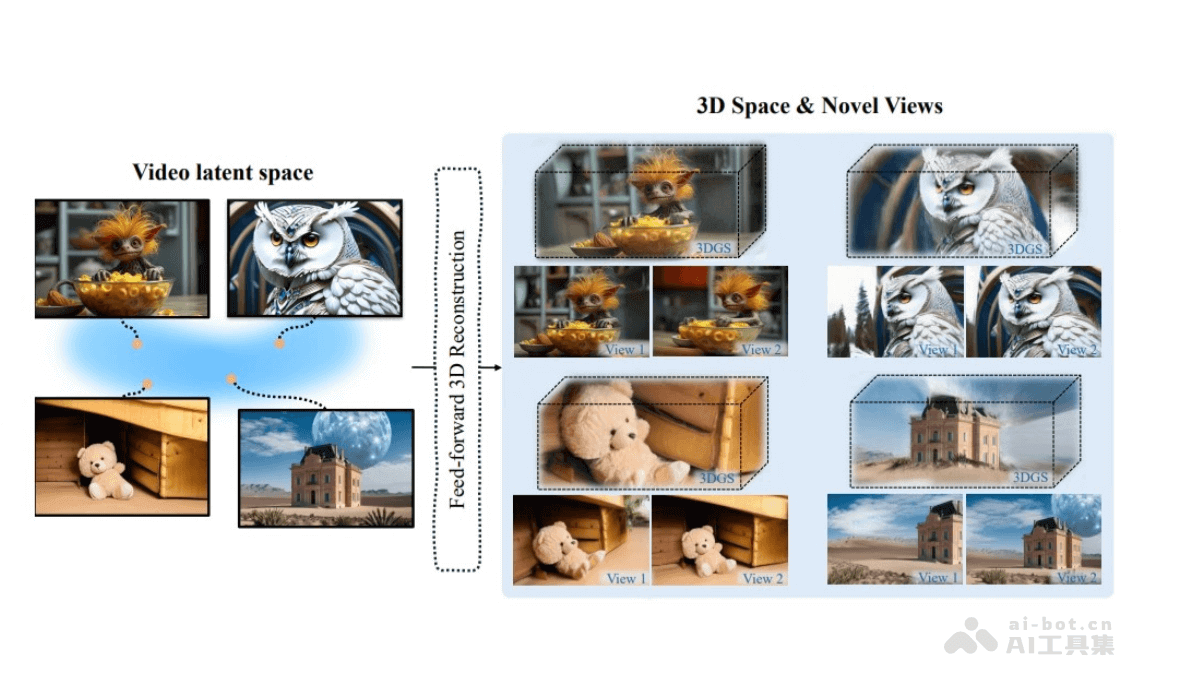

Wonderland – 多伦多大学、Snap和UCLA联合推出的单视图3D场景生成技术

发表时间:2024-12-31

Wonderland是多伦多大学、Snap和UCLA的研究团队推出的技术,能够从单张图像生成高质量、广范围的3D场景,允许控制摄像轨迹。证明了三维重建模型可以有效地建立在扩散模型的潜在空间上,实现高效的三维场景生成,是单视图3D场景生成领域的一次突破性进展。

【全文阅读】

-

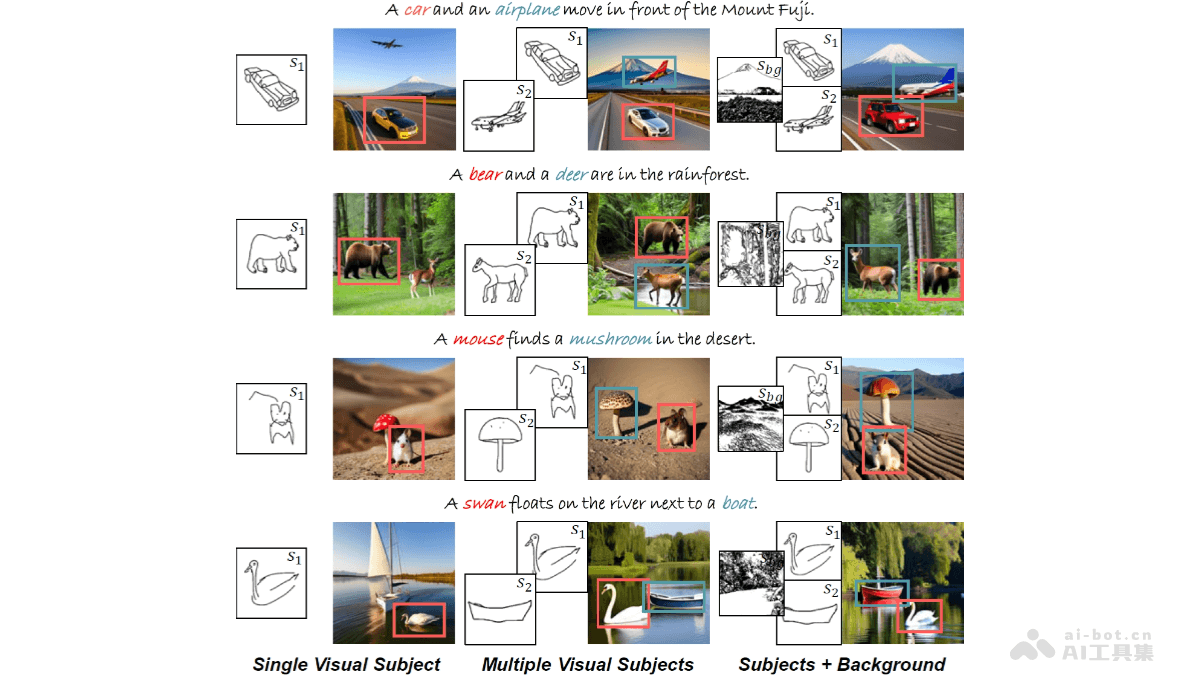

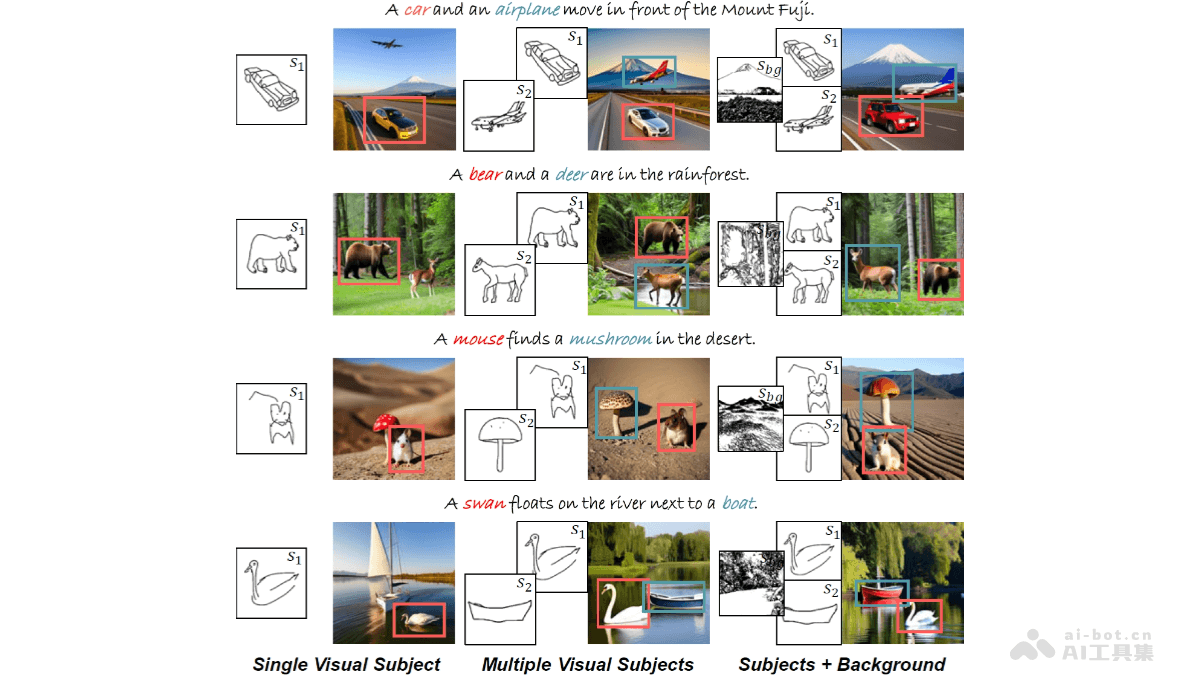

VersaGen – 实现文本到图像合成中视觉控制能力的生成式 AI 代理

发表时间:2024-12-31

VersaGen是文本到图像合成的生成式AI代理,能实现灵活的视觉控制能力。VersaGen能处理包括单一视觉主体、多个视觉主体、场景背景,这些元素的任意组合在内的多种视觉控制类型。基于在已有的文本主导的扩散模型上训练适配器,VersaGen成功地将视觉信息融入图像生成过程中。

【全文阅读】