GCDance – 萨里大学和江南大学推出的3D舞蹈生成框架

2025-04-16 14:23:45 小编:六六导航站

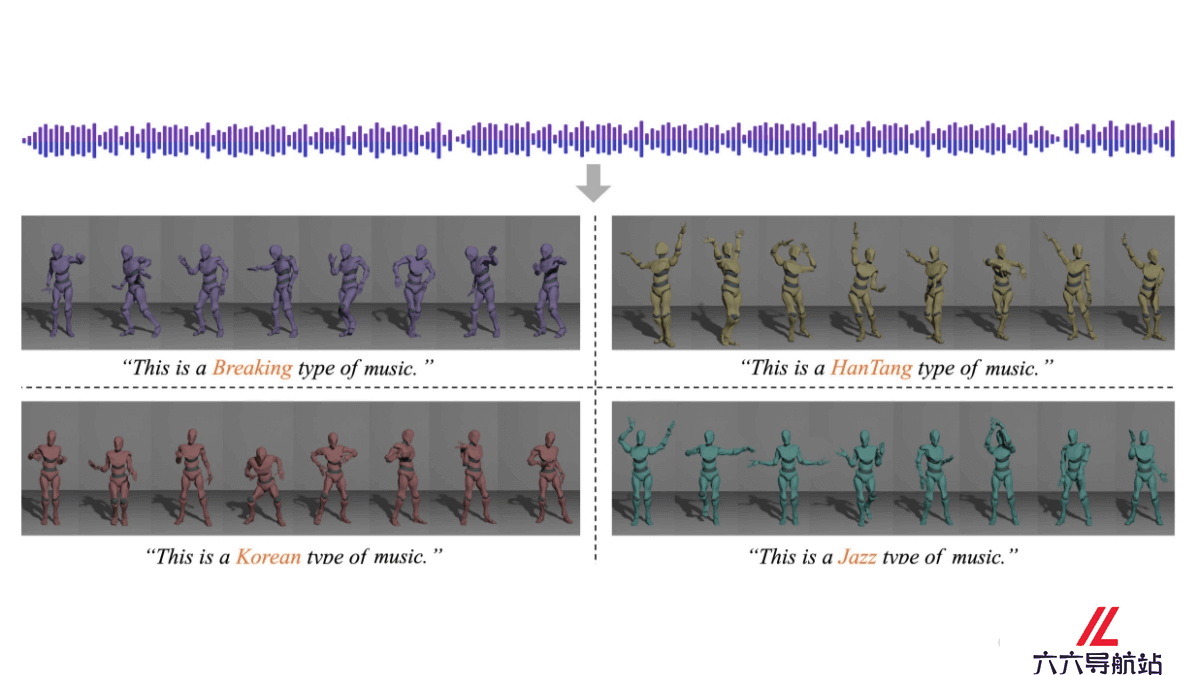

GCDance是什么

GCDance(Genre-Controlled 3D Full Body Dance Generation Driven by Music)是英国萨里大学和江南大学推出的3D舞蹈生成框架,能根据音乐和文本提示生成符合特定风格的全身舞蹈序列。GCDance结合预训练的音乐基础模型(如Wav2CLIP)提取的高级音乐特征和手工设计的音乐特征(如STFT),实现多粒度音乐特征融合,用CLIP模型将文本提示嵌入到舞蹈生成的每个时间步中,实现风格可控的舞蹈生成。GCDance支持在同一音乐片段下生成多种风格的舞蹈,且确保舞蹈动作与音乐的节奏和旋律高度一致。

GCDance的主要功能

风格可控的舞蹈生成:基于文本提示指定舞蹈风格(如街舞、爵士舞等),生成符合特定风格的舞蹈动作。与音乐节奏精准对齐:舞蹈动作能与音乐的节奏、节拍和旋律高度同步,确保舞蹈与音乐的自然匹配。多样化舞蹈生成:同一音乐片段支持生成多种风格的舞蹈,丰富舞蹈的表现力和多样性。支持局部编辑:用户能对舞蹈的特定部分(如手部动作或特定时间段)进行定制化修改。生成高质量全身动作:涵盖52个关节(包括手指关节),生成的舞蹈动作自然、逼真,具有较高的物理合理性。GCDance的技术原理

扩散模型框架:基于无分类器(classifier-free)扩散模型,用逐步去噪的方式从噪声中生成舞蹈序列。音乐特征提取:结合预训练的音乐基础模型(如Wav2CLIP)提取高级语义特征,及手工设计的音乐特征(如短时傅里叶变换STFT)捕捉低层次的音乐细节。多粒度特征融合方式能更好地捕捉音乐与舞蹈之间的复杂关系。文本特征嵌入:基于CLIP模型将文本提示(如舞蹈风格描述)嵌入到舞蹈生成的每个时间步中,用特征适配器(adapter)与其音乐特征对齐,实现风格可控的舞蹈生成。特征调制(FiLM):特征调制层(Feature-wise Linear Modulation, FiLM)根据文本提示动态调整舞蹈生成过程,确保生成的舞蹈符合指定风格。双流架构:针对身体动作和手部动作分别建模,用两个Transformer网络独立处理,生成更细致、更具表现力的全身舞蹈动作。编辑功能:基于扩散模型的编辑机制(如扩散修复),用户在生成过程中对舞蹈的特定部分施加约束,实现局部编辑和定制化生成。GCDance的项目地址

arXiv技术论文:https://arxiv.org/pdf/2502.18309GCDance的应用场景

虚拟现实(VR)和增强现实(AR):生成虚拟角色舞蹈,增强沉浸感。游戏开发:为游戏角色动态生成舞蹈动作,提升互动性。舞蹈教学:辅助编舞和教学,提供不同风格的舞蹈示例。音乐视频制作:根据音乐自动生成舞蹈,提供创意素材。智能健身:结合音乐生成健身舞蹈,增加锻炼趣味性。- 猜你喜欢

-

MusicTGA-HR提示指令

MusicTGA-HR提示指令 -

RappingAI提示指令

RappingAI提示指令 -

Boomy提示指令

Boomy提示指令 -

TwoShot提示指令

TwoShot提示指令 -

Weet提示指令

Weet提示指令 -

Muzaic Studio提示指令

Muzaic Studio提示指令 -

-

HookGen提示指令

HookGen提示指令 -

DadaBots提示指令

DadaBots提示指令

- 相关AI应用

-

Playlistable提示指令

Playlistable提示指令 -

Riffusion提示指令

Riffusion提示指令 -

WZRD提示指令

WZRD提示指令 -

-

Cyanite.ai提示指令

Cyanite.ai提示指令 -

Piano Genie提示指令

Piano Genie提示指令 -

Synthesizer V提示指令

Synthesizer V提示指令 -

Cosonify提示指令

Cosonify提示指令 -

Musico提示指令

Musico提示指令

- 推荐AI教程资讯

- GCDance – 萨里大学和江南大学推出的3D舞蹈生成框架

- LaWGPT – 南京大学推出的中文法律大语言模型

- GPT-4.1登场,实测碾压OpenAI所有模型,但效果不如Gemini?

- autoMate – AI本地自动化工具,自然语言实现自动化任务操作

- URO-Bench – AI基准测试工具,专为端到端语音对话模型设计

- Aya Vision – Cohere 推出多模态、多语言的视觉模型

- BGE-VL – 智源研究院联合多所高校开源的多模态向量模型

- 混元图生视频 – 腾讯混元开源的图生视频模型

- Granite 3.2 – IBM 开源的多模态系列 AI 模型

- Resume Matcher – 开源AI简历优化工具,解析简历和职位描述提供改进建议