I2VEdit – AI视频编辑技术,基于扩散模型实现首帧编辑引导

2025-02-10 10:18:51 小编:六六导航站

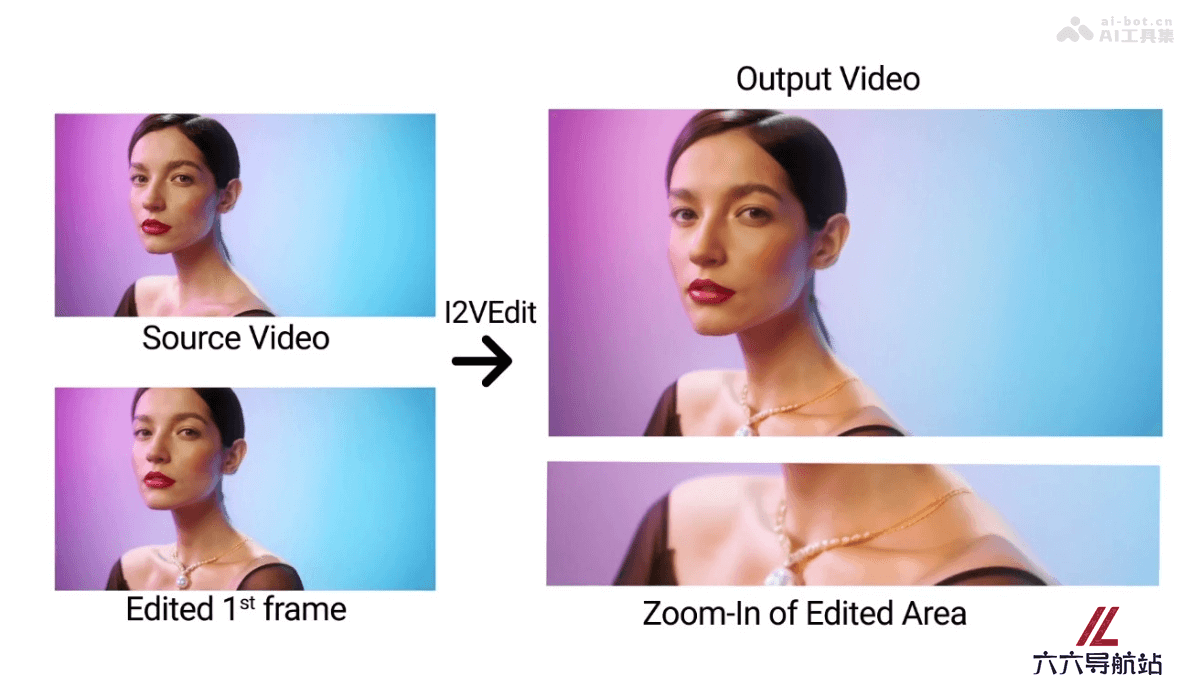

I2VEdit是什么

I2VEdit是一个先进的视频编辑框架,通过图像到视频的扩散模型实现首帧引导的视频编辑。用户只需编辑视频的第一帧,I2VEdit能自动将编辑效果应用到整个视频。I2VEdit由南洋理工大学、商汤科技研究院和上海人工智能实验室共同推出,能保持视频的时间和运动一致性,同时提供高质量的编辑结果。I2VEdit适合进行局部和全局编辑任务,如更换服装、添加配饰或风格转换,简化视频编辑过程。

I2VEdit的主要功能

首帧编辑引导:用户编辑视频的第一帧,I2VEdit将编辑自动扩展到整个视频。运动一致性:保持编辑后视频与原视频的运动连贯性。灵活编辑:支持局部编辑(如更换对象)和全局编辑(如风格转换)。高质量输出:生成与第一帧编辑一致且时间上连贯的高质量视频。I2VEdit的技术原理

粗运动提取:基于训练运动LoRA(低秩适应)模型学习视频中的粗略运动模式。外观细化:用细粒度的注意力匹配算法进行精确的外观调整。平滑区域随机扰动(SARP):对视频中的平滑区域添加随机扰动,改善从图像到视频的转换质量。间隔跳过策略:在处理长视频时,采用间隔跳过策略以减少自回归生成过程中的质量下降。扩散模型:基于预训练的图像到视频扩散模型,将编辑从第一帧传播到整个视频。I2VEdit的项目地址

项目官网:i2vedit.github.ioarXiv技术论文:https://arxiv.org/pdf/2405.16537I2VEdit的应用场景

社交媒体内容创作:内容创作者快速更改视频中的元素,如服饰、背景,匹配特定的主题或品牌。视频后期制作:电影和视频制作人员用I2VEdit快速进行风格转换或场景更改,提高后期制作的效率。虚拟试穿:在时尚和零售领域,顾客观看模特穿着不同服饰的视频,商家快速生成多个试穿效果。主题替换:在教育和培训视频中,轻松替换演示的主角或背景,适应不同的教学场景。风格转换:艺术家和设计师探索不同的视觉风格,如将现实视频转换成卡通风格,而无需手动重绘每一帧。特效制作:在视频制作中,I2VEdit快速应用特效,如改变视频中物体的颜色或添加特殊效果。- 猜你喜欢

-

ChatPPT提示指令

ChatPPT提示指令 -

Chad GPT提示指令

Chad GPT提示指令 -

Valideo提示指令

Valideo提示指令 -

GPT Stylist提示指令

GPT Stylist提示指令 -

-

-

FictionGPT提示指令

FictionGPT提示指令 -

-

Embra提示指令

Embra提示指令

- 相关AI应用

-

ChatGPT Super提示指令

ChatGPT Super提示指令 -

DapperGPT提示指令

DapperGPT提示指令 -

IMI Prompt提示指令

IMI Prompt提示指令 -

Enhanced ChatGPT提示指令

Enhanced ChatGPT提示指令 -

Ghostwrite提示指令

Ghostwrite提示指令 -

悟智写作提示指令

悟智写作提示指令 -

-

BraveGPT提示指令

BraveGPT提示指令 -

ChatGPT Sidebar提示指令

ChatGPT Sidebar提示指令

- 推荐AI教程资讯

- I2VEdit – AI视频编辑技术,基于扩散模型实现首帧编辑引导

- HouseCrafter – 东北大学和 Stability AI推出2D转换3D室内场景的技术

- AMD-135M – AMD推出的首款小型语言模型

- JoyHallo – 京东推出的音频驱动视频生成AI数字人模型

- Seed-VC – 零样本实现声音克隆和转换的技术

- Phidias – 检索增强的3D内容生成模型,支持多模态输入

- Movie Gen – Meta推出文本驱动的AI视频生成与编辑工具

- Mini-LLaVA – 基于Llama 3.1的轻量级多模态大语言模型

- MemoryScope – 为LLM聊天机器人配备的长期记忆系统

- CogView3 – 智谱AI推出的开源AI图像生成模型

- 精选推荐

-

词魂2025-01-02提示指令

词魂2025-01-02提示指令 -

法智2025-01-02法律助手

法智2025-01-02法律助手 -

WisdomAI by Searchie2025-01-29法律助手

WisdomAI by Searchie2025-01-29法律助手 -

Awesome ChatGPT Prompts2025-01-02提示指令

Awesome ChatGPT Prompts2025-01-02提示指令 -

Content Generator2025-02-06法律助手

Content Generator2025-02-06法律助手 -

悟智写作2025-02-05提示指令

悟智写作2025-02-05提示指令